วิธีจับผิด AI ไม่ให้โดนหลอก เมื่อ AI พัฒนาขึ้นไปมากจนมันสามารถสร้างรูปภาพ วิดีโอ เสียง และบอตได้เนียนเหมือนของจริง แล้วเราจะแยกได้อย่างไรว่าอันไหนจริง อันไหนปลอม?

เมื่อ AI สร้างสรรค์ผลงานได้เนียนมาก ๆ ทั้งภาพ วิดีโอ เสียง และข้อความจนยากที่จะแยกที่จะดูออกทำให้เราตกอยู่ภายใต้ข้อมูลที่อาจเป็นเท็จก็ได้ แต่ถ้าหากคุณทราบถึงวิธี และสัญญาณบ่งชี้ต่างๆ ที่บอกว่าผลงานที่คุณกำลังดู หรือฟังอยู่เป็นของปลอมที่ AI สร้างขึ้น คุณก็จะช่วยปกป้องตัวเองไม่ให้ถูกหลอกได้

จากรายงานของ World Economic Forum ได้บอกว่า ข้อมูลเท็จและข้อมูลบิดเบือนอาจ “ก่อความปั่นป่วนอย่างรุนแรงต่อกระบวนการเลือกตั้งในหลายประเทศในอีกสองปีข้างหน้า” ขณะที่การเข้าถึงเครื่องมือ AI ได้ง่ายขึ้น “ทำให้เกิดการระเบิดของข้อมูลปลอมและเนื้อหาสังเคราะห์ เช่น การโคลนนิ่งเสียงที่ซับซ้อน ไปจนถึงเว็บไซต์ปลอม”

คำว่า Misinformation และ Disinformation ต่างก็หมายถึงข้อมูลเท็จหรือไม่ถูกต้อง แต่ Disinformation คือข้อมูลที่ตั้งใจจะหลอกลวงหรือทำให้เข้าใจผิด “ปัญหาเกี่ยวกับ Disinformation ที่ใช้ AI คือขนาด ความเร็ว และความง่ายในการสร้าง” Hany Farid จาก University of California, Berkeley กล่าว “การโจมตีเหล่านี้ ไม่ต้องอาศัยผู้กระทำผิดที่ได้รับการสนับสนุนจากรัฐหรือองค์กรที่มีเงินทุนมากมาย เพียงแค่บุคคลคนเดียวที่มีการเข้าถึงพลังการประมวลผลคอมพิวเตอร์เพียงเล็กน้อยก็สามารถสร้างเนื้อหาปลอมจำนวนมากได้” เขาบอกว่า Generative AI กำลัง “ทำให้ระบบข้อมูลทั้งหมดปนเปื้อน ทำให้ทุกสิ่งที่เราอ่าน เห็น และได้ยินเป็นเรื่องน่าสงสัย” เขาบอกว่าการวิจัยของเขาชี้ให้เห็นว่า ในหลายกรณี ภาพและเสียงที่สร้างขึ้นโดย AI “แทบแยกไม่ออกจากความเป็นจริงเลย”

อย่างไรก็ตาม การวิจัยของ Farid และผู้อื่นเผยให้เห็นว่ามีกลยุทธ์ที่ทำให้สามารถลดความเสี่ยงในการตกเป็นเหยื่อของข้อมูลเท็จหรือข้อมูลบิดเบือนบนโซเชียลมีเดียที่สร้างขึ้นโดย AI ได้ซึ่งจะแบ่งเป็นการสังเกตภาพจาก AI, วิดีโอปลอมแบบ Deepfake, บัญชีโซเชียลมีเดียที่เป็น AI bot และการโคลนเสียงจาก AI

วิธีจับผิดภาพจาก AI

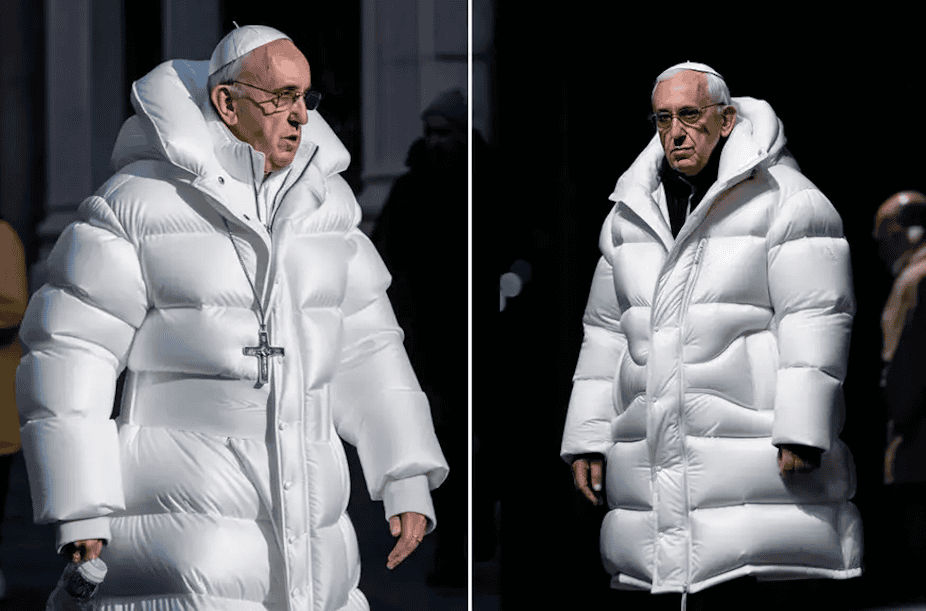

วิธีการสังเกตภาพ AI ปลอม จำได้ไหมว่าเคยเห็นภาพ Pope Francis สวมแจ็คเก็ต? ภาพ AI ปลอมเช่นนี้กลายเป็นเรื่องธรรมดาขึ้นเรื่อย ๆ การศึกษาหนึ่งโดย Nicholas Dufour ที่ Google และเพื่อนร่วมงานของเขาพบว่าสัดส่วนของภาพที่สร้างขึ้นโดย AI ที่เป็นข้อมูลเท็จได้รับการตรวจสอบข้อเท็จจริงเพิ่มขึ้นอย่างรวดเร็วตั้งแต่ต้นปี 2023 เป็นต้นมา

“ทุกวันนี้ ความรู้ด้านสื่อต้องอาศัยความรู้ด้าน AI” Negar Kamali จาก Northwestern University ใน Illinois กล่าว ในปี 2024 เธอและเพื่อนร่วมงานได้ระบุ 5 ข้อผิดพลาดของภาพที่สร้างขึ้นโดย AI และให้คำแนะนำเกี่ยวกับวิธีสังเกตข้อผิดพลาดเหล่านี้ ซึ่งมีความแม่นยำประมาณ 70 เปอร์เซ็นต์ในการตรวจจับภาพปลอมของ AI

5 วิธีจับผิดรูปภาพที่สร้างโดย AI

- ความไม่น่าเชื่อถือทางสังคมและวัฒนธรรม: ภาพที่สร้างจาก AI อาจแสดงถึงพฤติกรรมที่หายาก ผิดปกติ หรือแปลกประหลาดสำหรับวัฒนธรรม หรือบุคคลสำคัญในประวัติศาสตร์

- ความไม่น่าเชื่อถือทางกายวิภาค: เมื่อสังเกตอย่างใกล้ชิด จะเห็นว่าส่วนต่างๆ ของร่างกาย เช่น มือมีรูปร่างหรือขนาดผิดปกติ ดวงตาหรือปากดูแปลก หรือมีส่วนใดของร่างกายที่ไม่ผสานกัน

- การประดิษฐ์สไตล์ภาพ: รูปภาพดูไม่เป็นธรรมชาติ สมบูรณ์แบบเกินไป พื้นหลังดูแปลกหรือขาดบางอย่างไป แสงดูแปลกหรือผิดปกติ

- ความไม่น่าเชื่อถือวัตถุในภาพ: มีวัตถุใดดูแปลกประหลาดหรือดูเหมือนว่าจะไม่ใช่ของจริง ตัวอย่างเช่น มีกระดุมหรือหัวเข็มขัดอยู่ในสถานที่แปลก ๆ ที่ ๆ ไม่ควรอยู่

- การละเมิดกฎฟิสิกส์: เงาชี้ไปในทิศทางที่ต่างกัน เงาที่สะท้อนในกระจกไม่สอดคล้องกับสิ่งที่ควรจะเป็น

วิธีจับผิดวิดีโอปลอมที่สร้างจาก Deepfake

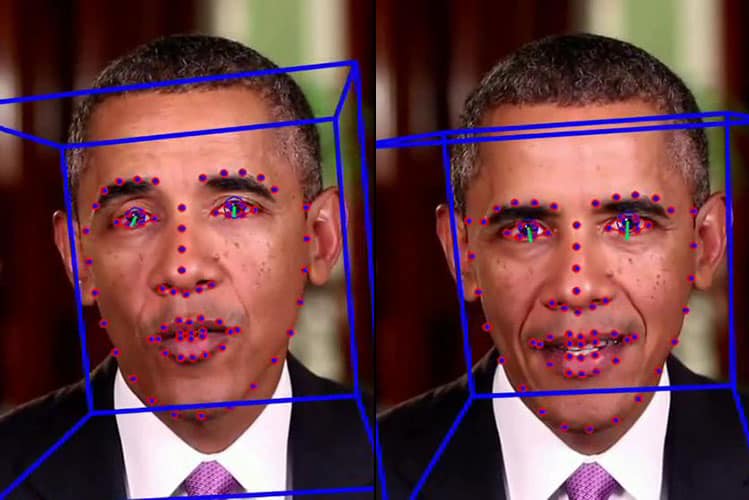

Deepfake เกิดขึ้นตั้งแต่ปี 2014 โดยดัดแปลงวิดีโอที่มีอยู่ของใครก็ตามให้สลับหน้ากัน สร้างการแสดงออกทางสีหน้าใหม่ และแทรกเสียงพูดใหม่ที่มีการจับคู่ลิปซิงค์ ทำให้กลุ่มนักต้มตุ๋น แฮกเกอร์ และผู้ใช้อินเทอร์เน็ตสามารถสร้างวิดีโอปลอมจาก Deepfake ได้ง่ายๆ ซึ่งคนดังอย่าง Taylor Swift หรือประธานาธิบดี Barack Obama ไปจนถึงคนธรรมดามีความเสี่ยงที่จะถูกนำใบหน้าไปแสดงในสื่อลามกอนาจารโดยไม่ได้รับความยินยอม ไปจนถึงการหลอกลวง และการให้ข้อมูลที่บิดเบือน

นักวิจัยจาก Massachusetts Institute of Technology (MIT) และ Northwestern University ได้รวบรวม 6 เคล็ดลับที่ช่วยให้สังเกตวิดีโอปลอมจาก Deepfake ได้ง่ายขึ้น

6 วิธีจับผิดคลิปวิดีโอจาก Deepfake

- การเคลื่อนไหวของปากและริมฝีปาก: มีช่วงเวลาที่ภาพและเสียงไม่ซิงค์กันอย่างสมบูรณ์

- ข้อผิดพลาดทางกายวิภาค: ใบหน้าหรือร่างกายดูแปลก หรือการเคลื่อนไหวไม่เป็นธรรมชาติ

- ใบหน้า: ความไม่สอดคล้องกัน ใบหน้าไม่เรียบเนียน หรือมีริ้วรอยรอบหน้าผากและแก้ม รวมถึงไฝบนใบหน้า

- แสง: แสงไม่สม่ำเสมอ เงาผิดปกติไม่เป็นธรรมชาติ จุดสังเกตที่สำคัญคือดวงตา คิ้ว และแว่นตา

- ผม หนวด และเครา : ผม หนวด เคราดูแปลก หรือเคลื่อนไหวไม่เป็นธรรมชาติ

- การกระพริบตา: กระพริบตาบ่อยเกินไป หรือน้อยเกินไป

วิธีจับผิด AI Bot

บัญชีโซเชียลมีเดียที่ควบคุมโดยบอตกลายเป็นเรื่องปกติในโลกโซเชียลมีเดีย และแพลตฟอร์มการส่งข้อความ บอทเหล่านี้มีจำนวนมากขึ้นเรื่อย ๆ จากเทคโนโลยี Generative AI ตั้งแต่ปี 2022 ซึ่งทำให้การผลิตเนื้อหาเป็นเรื่องง่าย และมีค่าใช้จ่ายต่ำ

Paul Brenner จาก University of Notre Dame ใน Indiana กล่าวว่า “การปรับแต่งโมเดลภาษาขนาดใหญ่เหล่านี้ให้เหมาะกับกลุ่มเป้าหมายแบบเฉพาะเจาะจงนั้นง่ายขึ้นมาก”

Paul Brenner และเพื่อนร่วมงานของเขาได้ทำการวิจัยและพบว่าอาสาสมัครสามารถแยกแยะบอตที่ขับเคลื่อนด้วย AI จากมนุษย์ได้เพียงประมาณ 42 เปอร์เซ็นต์เท่านั้น ซึ่งผู้เข้าร่วมการวิจัยเหล่านี้ได้รับแจ้งแล้วด้วยว่าอาจพูดคุยกับบอต โดย Paul Brenner ได้ระบุถึงเคล็ดลับการจับผิด AI Bot เอาไว้ดังนี้

5 วิธีจับผิดบัญชีโซเชียลมีเดียที่เป็นบอต AI

- อีโมจิและแฮชแท็ก: มีการใช้อีโมจิและแฮชแท็กมากเกินไป

- การใช้คำที่ไม่ค่อยใช้กันและการเลือกคำ: การใช้คำของบอตอาจเป็นคำที่ไม่ค่อยใช้กันโดยทั่วไป

- การทำซ้ำและโครงสร้าง: บอทอาจใช้คำซ้ำ ๆ ที่มีรูปแบบคล้ายกันหรือตายตัว และอาจใช้คำแสลงบางคำมากเกินไป

- ถามคำถาม: การถามคำถามอาจเผยให้เห็นว่าบอตขาดความรู้เกี่ยวกับหัวข้อใดหัวข้อหนึ่ง โดยเฉพาะอย่างยิ่งเมื่อถามเรื่องที่เกี่ยวกับสถานที่ และสถานการณ์ในท้องถิ่น

- คิดในแง่ร้าย: หากบัญชีโซเชียลมีเดียนั้นไม่ได้ยืนยันตัวตนอย่างชัดเจน บัญชีนั้นอาจเป็นบอต AI

วิธีจับผิดการโคลนเสียงจาก AI และ Deepfake

การโคลนเสียงด้วยเครื่องมือ AI ทำให้การสร้างเสียงพูดใหม่ ๆ ที่สามารถเลียนแบบเสียงของใครก็ได้ สิ่งนี้ทำให้เกิดการหลอกลวงแบบ Deepfake ที่โคลนเสียงของสมาชิกในครอบครัว ผู้บริหารบริษัท และผู้นำทางการเมือง เช่น ประธานาธิบดีโจ ไบเดนของสหรัฐฯ หรือการขโมยเสียงของทั้งบุคคลที่มีชื่อเสียง และไม่มีชื่อเสียงไปใช้เทรนเอไอ แล้วนำไปใช้ในทางที่ผิด ซึ่งอาจระบุได้ยากกว่าวิดีโอหรือรูปภาพที่สร้างโดย AI มาก

“การโคลนเสียงนั้นค่อนข้างท้าทายในการแยกแยะระหว่างเสียงจริงกับเสียงปลอม เพราะไม่มีองค์ประกอบทางสายตาที่จะช่วยสมองของเราตัดสินใจ” Rachel Tobac ผู้ก่อตั้งร่วมของ SocialProof Security ซึ่งเป็นองค์กรแฮกเกอร์ด้านความปลอดภัย (White-hat Hacking) กล่าว

การตรวจจับเสียง Deepfake จาก AI อาจทำได้ยากโดยเฉพาะเมื่อใช้ในวิดีโอและการโทร แต่ก็ไม่ใช่เรื่องที่เป็นไปไม่ได้ที่จะสังเกตเสียงเหล่านี้

4 วิธีจับผิดเสียงที่ถูกโคลน หรือปลอมแปลงโดย AI

- บุคคลสาธารณะ: หากคลิปเสียงเป็นของบุคคลสาธารณะหรือผู้มีชื่อเสียง เราควรจะตรวจสอบสิ่งที่เขาพูดนั้นว่าสอดคล้องกับรายงานอื่น ๆ ที่เผยแพร่ต่อสาธารณะ ทัศนคติ และพฤติกรรมของพวกเขาหรือไม่?

- มองหาความไม่สอดคล้องกัน: เปรียบเทียบกับคลิปเสียงกับวิดีโอ หรือคลิปเสียงของบุคคลเดียวกันที่ผ่านการยืนยันว่าเป็นของจริงก่อนหน้านี้ ว่ามีความสอดคล้องกันหรือไม่ เช่นเสียงของเขา หรือลักษณะการพูด

- ความเงียบ: หากคุณกำลังฟังการสนทนาทางโทรศัพท์หรือข้อความเสียง และผู้พูดฝ่ายตรงข้ามหยุดพูดไปนานผิดปกติ อาจเป็นเพราะว่าพวกเขากำลังสร้างเสียงโคลนด้วย AI อยู่ เพื่อนำเสียงนั้นมาตอบคำถามเรา

- พูดแปลก ๆ และใช้คำฟุ่มเฟือย: รูปแบบการพูดที่เหมือนหุ่นยนต์หรือลักษณะการพูดที่เยิ่นเย้อผิดปกติ

การจับผิด AI จะยากขึ้นเรื่อยๆ

ในขณะนี้ยังไม่มีกฎเกณฑ์ตายตัวใด ๆ ที่จะแยกแยะเนื้อหาที่สร้างโดย AI กับเนื้อหาของมนุษย์ที่แยกแยะได้แบบ 100% โมเดล AI ที่สามารถสร้างข้อความ รูปภาพ วิดีโอ และเสียงได้นั้นยังคงพัฒนาต่อไปอย่างต่อเนื่อง และมันก็จะสร้างเนื้อหาที่ดูเหมือนจริงมากขึ้นเรื่อย ๆ เราจึงต้องตระหนักอยู่เสมอว่า ภาพ คลิป เสียง หรือเนื้อหาที่เรากำลังเผชิญอยู่อาจสร้างมาจาก AI ก็ได้ และมันก็มีโอกาสที่จะบิดเบือนข้อมูลจากข้อเท็จจริง ขณะเดียวกันนั้นการสร้างสรรค์ผลงานจาก AI ก็ควรจะคำนึงถึงจริยธรรม (AI Ethics) ด้วยเช่นกัน

ชมรายการ Digital Thailand ตอน “ วิธีจับผิด AI รู้ก่อนโดนหลอก! จับผิดอันไหนของจริง อันไหน AI ดูยังไง? ” ได้ที่รายการย้อนหลังตอนนี้เลย

https://it24hrs.com/2024/ai-fake-image-picture-voice-deepfake-bot/

ออกอากาศวันเสาร์ที่ 14 ธันวาคม 2567

ในรายการ Digital Thailand ทุกวันเสาร์ ทางช่อง 3 กด 33 เวลา 4.40-5.05 น.

ยังมีบทความที่น่าสนใจ

ดู URL ปลอม ดูลิงก์ให้เป็น! รอดจากโดนมิจฉาชีพหลอกได้ 80% ดูยังไง?

10 เครื่องมือ AI ยอดนิยม 2024 เอไอตัวไหนคนใช้มากที่สุด?

อย่าลืมกดติดตามอัปเดตข่าวสาร เทคนิคดีๆกันนะคะ Please follow us

Youtube it24hrs

Twitter it24hrs

Tiktok it24hrs

facebook it24hrs

ติดต่อโฆษณา [email protected] โทร 0802345023